|

|

Определение параметров линейной регрессии.

Регрессионный анализ (линейный) — статистический метод исследования зависимости между зависимой переменной Y и одной или несколькими независимыми переменными X1,X2,...,Xp. Независимые переменные иначе называют регрессорами или предикторами, а зависимые переменные — критериальными. Терминология зависимых и независимых переменных отражает лишь математическую зависимость переменных (см. Ложная корреляция), а не причинно-следственные отношения.

Метод наименьших квадратов (расчёт коэффициентов)

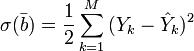

На практике линия регрессии чаще всего ищется в виде линейной функции Y = b0 + b1X1 + b2X2 + ... + + bNXN (линейная регрессия), наилучшим образом приближающей искомую кривую. Делается это с помощью метода наименьших квадратов, когда минимизируется сумма квадратов отклонений реально наблюдаемых Y от их оценок (имеются в виду оценки с помощью прямой линии, претендующей на то, чтобы представлять искомую регрессионную зависимость):

(M - объем выборки). Этот подход основан на том известном факте, что фигурирующая в приведенном выражении сумма принимает минимальное значение именно для того случая, когда Y = y(x1,x2,...xN).

Метод наименьших квадратов заключается в поиске наиболее подходящей линии зависимости, чтобы таким образом минимизировать разность значений искомой функции и фактического значения.

Для решения задачи регрессионного анализа методом наименьших квадратов вводится понятие функции невязки:

Условие минимума функции невязки:

Полученная система является системой N + 1 линейных уравнений с N + 1 неизвестными b0...bN

Если представить свободные члены левой части уравнений матрицей

а коэффициенты при неизвестных в правой части матрицей

то получаем матричное уравнение: , которое легко решается методом Гаусса. Полученная матрица будет матрицей, содержащей коэффициенты уравнения линии регрессии: